"No podemos proporcionar comentarios específicos sobre los resultados de su entrevista".

En los Estados Unidos, cada vez más empleadores utilizan inteligencia artificial (IA) para acelerar el proceso de contratación. Pero los solicitantes de empleo rara vez saben por qué las herramientas de reclutamiento de IA rechazan sus currículums o cómo analizar sus entrevistas en video. Cuando pierden las elecciones, a menudo solo pueden recibir un correo electrónico tan frío, sin saber por qué perdieron las elecciones.

▲ Imagen de: unsplash

Esto es perturbador ¿Qué tipo de poder de toma de decisiones juega la IA en nuestras carreras?

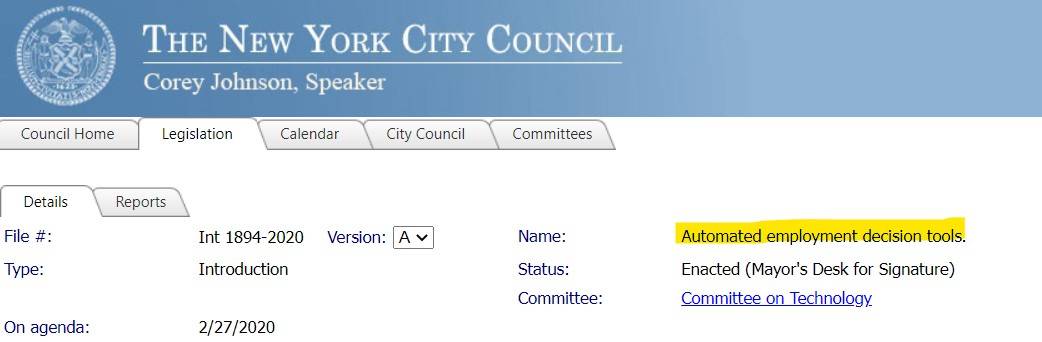

The Associated Press informó que a principios de noviembre, el Ayuntamiento de Nueva York aprobó un proyecto de ley por 38 votos contra 4: si el sistema de reclutamiento de IA no pasa la auditoría anual, será prohibido. La auditoría anual verificará el sistema de reclutamiento de IA en busca de discriminación racial o de género, lo que permitirá a los solicitantes de empleo elegir alternativas como la revisión manual, y los desarrolladores de IA deberán revelar más detalles que no fueron transparentes en el pasado.

Curiosamente, los desarrolladores de IA son responsables de la auditoría anual, pero el empleador será castigado. Si utilizan un sistema de reclutamiento de IA que no pasa la auditoría anual, la pena máxima por cada infracción es de $ 1,500.

Los partidarios creen que el proyecto de ley abrirá una ventana a algoritmos complejos. Los algoritmos a menudo clasifican las habilidades y personalidades en función de cómo hablan o escriben los solicitantes de empleo, pero es dudoso que la máquina pueda juzgar con precisión y equidad las características de la personalidad y las señales emocionales. Este proceso será más transparente en el futuro.

Como mínimo, tiene sentido saber que "el algoritmo es rechazado porque está sesgado". Sandra Wachter, profesora de derecho técnico en la Universidad de Oxford, dijo una vez:

La ley contra la discriminación se basa principalmente en quejas, si no saben lo que les sucedió, nadie puede quejarse de que se les niegue una oportunidad laboral.

La empresa emergente Pymetrics también apoya mucho este proyecto de ley. Ellos abogan por el uso de la IA para realizar entrevistas a través de juegos y otros métodos, y creen que cumple con los requisitos de equidad. Al mismo tiempo, los programas de entrevistas de inteligencia artificial obsoletos se tirarán a la basura. HireVue, un proveedor de sistemas de reclutamiento de IA, ha comenzado a eliminar gradualmente su herramienta de escaneo facial a principios de este año. Esta herramienta es llamada "pseudociencia" por la academia, que recuerda a la teoría frenológica del racismo.

La mayor parte de la oposición al proyecto de ley se basa en "esto está lejos de ser suficiente". Alexandra Givens, presidenta del Centro para la Democracia y la Tecnología, señaló que la propuesta en realidad solo requiere que los empleadores cumplan con los requisitos existentes de la ley de derechos civiles de EE. UU. Que prohíbe el reclutamiento que tiene diferentes efectos en función de la raza, el origen étnico o el género, pero ignora los prejuicios contra la discapacidad o la edad.

▲ Imagen de: unsplash

Y a algunos expertos en inteligencia artificial y activistas de derechos digitales les preocupa que el proyecto de ley solo permita a los desarrolladores de inteligencia artificial autocertificar que han cumplido con los requisitos básicos, y solo establece estándares débiles para los reguladores y legisladores federales. El "sesgo de auditoría" específico es muy vago.

Vale la pena señalar que los sesgos no son infrecuentes en las entrevistas. El principal problema radica en la muestra de algoritmos de alimentación, pero a menudo se colocan en una "caja negra", que es difícil de detectar para los solicitantes de empleo ordinarios.

Hace unos años, Amazon descontinuó su herramienta de escaneo de currículums porque favorecía a los hombres en puestos técnicos. Parte de la razón es que compara las condiciones de los solicitantes de empleo con la fuerza laboral masculina calificada dentro de la empresa; de la misma manera, si el algoritmo se nutre de industrias donde las diferencias étnicas y de género ya son comunes, entonces solo está consolidando prejuicios.

Este prejuicio no es solo la contratación. En abril de este año, un nuevo estudio de la Universidad del Sur de California mostró que Facebook muestra anuncios de formas que pueden violar la Ley contra la discriminación. Es más probable que los hombres vean anuncios de reclutamiento de conductores de reparto de pizzas, mientras que las mujeres ver compras anunciar.

▲ Imagen de: unsplash

En esencia, la discriminación de la IA es cultivada por la sociedad humana, y el comportamiento sesgado individual es incluso subconsciente, y es posible que nosotros mismos no nos demos cuenta. Si compara una empresa con menos prejuicios con una empresa con prejuicios graves, generalmente hay dos razones: la primera es mejor para eliminar deliberadamente los prejuicios y la segunda es mejor para recopilar un status quo irrazonable y perpetuarlo.

Por lo tanto, la opinión neutral cree que la mejor parte de la propuesta de la ciudad de Nueva York son sus requisitos de divulgación para que las personas sepan que están siendo evaluados por AI, cómo son evaluados por AI y hacia dónde van sus datos.

▲ Materiales de referencia:

1.https: //apnews.com/article/technology-business-race-and-etnicity-racial-injustice-artificial-intelligence-2fe8d3ef7008d299d9d810f0c0f7905d

2.https: //apnews.com/article/job-seekers-artificial-intelligence-hiring-decisions-784ccec7ac6175aadc573465ab604fb9

#Bienvenido a seguir la cuenta oficial de WeChat de Aifaner: Aifaner (ID de WeChat: ifanr), se le proporcionará más contenido emocionante lo antes posible.