Twitter revela que abandonó el cultivo de IA debido a sesgos de raza y género

La primera vez que escuchamos la idea de que el algoritmo de recorte de imágenes de Twitter puede tener algunos sesgos fue en septiembre de 2020.El ingeniero criptográfico Tony Arcieri subió dos imágenes con el líder de la mayoría del Senado, Mitch McConnell y el ex presidente Barack Obama, y la IA apareció en el rostro de McConnell en ambas ocasiones. .

Cuando la controversia finalmente llegó a la gente de Twitter, la compañía prometió analizar su modelo. Finalmente, podemos leer esos hallazgos.

Twitter comparte los resultados de su análisis de algoritmos

A principios de mayo, Twitter finalmente lanzó vistas previas de imágenes a tamaño completo en sus líneas de tiempo móviles. Una publicación en el blog de Twitter reveló que la aplicación eliminó su algoritmo de recorte de imágenes después de que un análisis mostrara que tenía sesgos basados en la raza y el género.

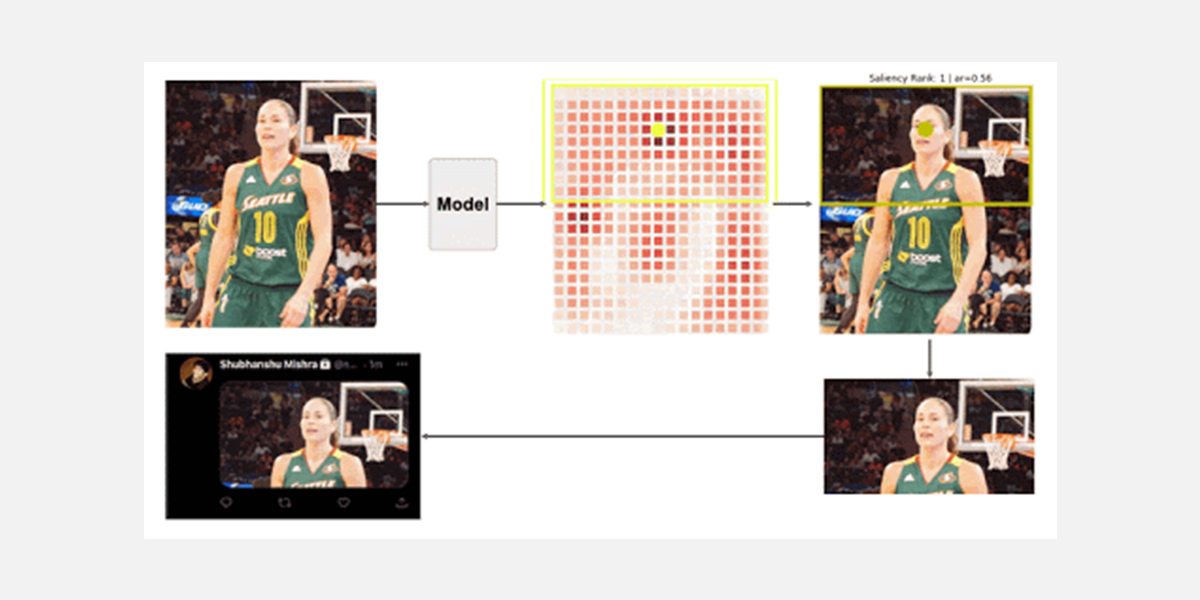

La plataforma comenzó a usar un algoritmo de prominencia en 2018 para recortar sus imágenes. Twitter dice que los modelos de prominencia se entrenan con datos de seguimiento ocular humano, que luego el algoritmo usa para estimar qué sujetos / elementos de la imagen cree que es más probable que sean importantes para la mayoría de las personas.

Luego, el algoritmo generaría una puntuación de prominencia para todas las partes de la imagen antes de elegir el punto con la puntuación más alta para que sea el centro del recorte.

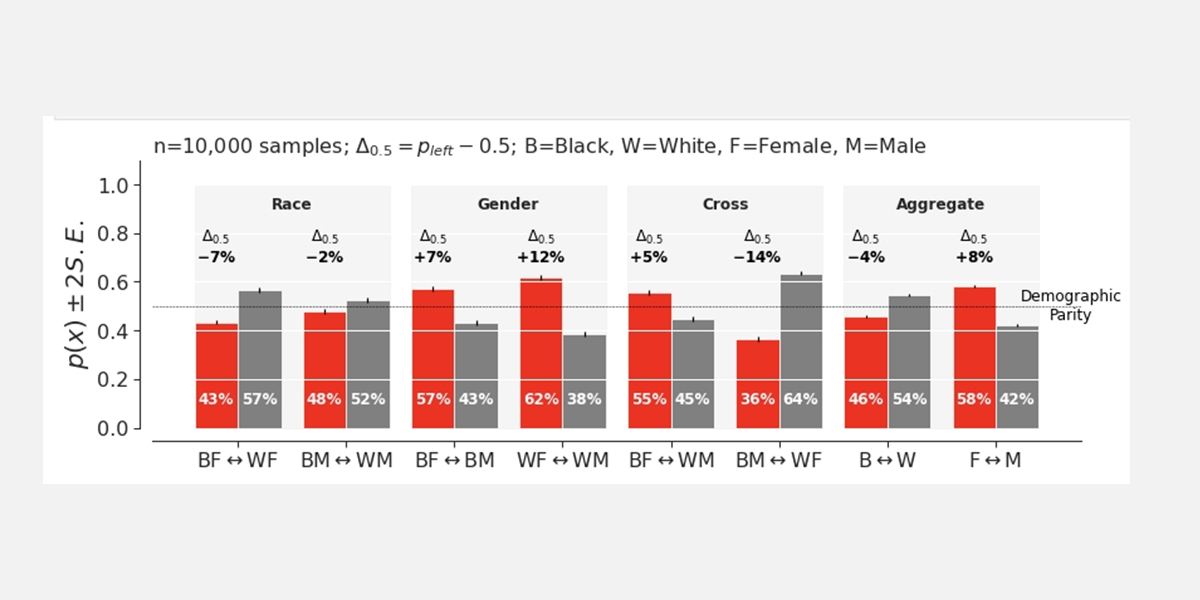

Después de ejecutar una prueba cuantitativa para verificar posibles sesgos, el equipo descubrió que el algoritmo de prominencia parecía favorecer a las mujeres sobre los hombres y a las personas blancas sobre las personas negras.

Twitter también probó el algoritmo para la "mirada masculina", pero no se encontró evidencia de sesgo de objetivación.

Incluso si el algoritmo de prominencia se ajustara para reflejar la igualdad perfecta entre los subgrupos de raza y género, a nosotros [Twitter] nos preocupa el daño representativo del algoritmo automatizado cuando las personas no pueden representarse a sí mismas como deseen en la plataforma. La prominencia también tiene otros daños potenciales más allá del alcance de este análisis, incluida la insensibilidad a los matices culturales.

Al considerar las compensaciones entre la velocidad y la consistencia del recorte automatizado y sus riesgos, Twitter dice que su equipo se dio cuenta de que cómo recortar una imagen es una decisión que mejor toman las personas, no los algoritmos.

Twitter se deshace del recorte automático de imágenes

Twitter ya no usa el algoritmo de prominencia y ahora muestra fotos de relación de aspecto estándar en su totalidad tanto en iOS como en Android. Al crear un tweet, encontrará que la nueva actualización también incluye una vista previa real de las imágenes cargadas, para que sepa cómo se verá todo una vez publicado.

Si está interesado en leer el artículo académico del estudio, puede encontrarlo en arXiv.org . También puede encontrar el código de Twitter para el análisis en GitHub .