Terminé este artículo con AI, y el editor en jefe dijo bien hecho, no lo usaré mañana.

La mayoría de los trabajadores literarios y artísticos, como los que escriben, dibujan y componen, corren un mayor riesgo de desempleo; todas las ilustraciones de este artículo fueron creadas por AI. Pero el texto está escrito por mí mismo, como un reemplazo falso.

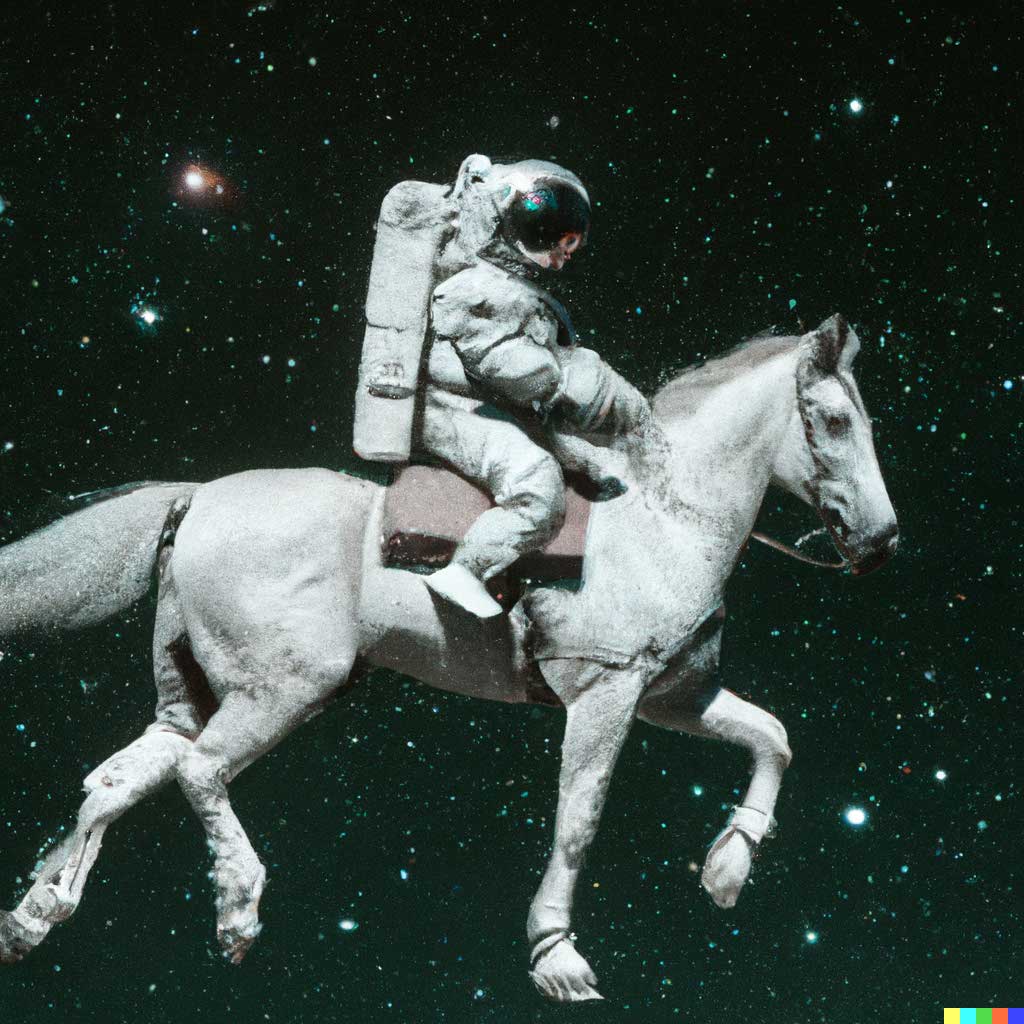

Una serie reciente de hermosas pinturas creadas por Dall-E 2 de Open AI, así como textos escritos en conjunto con Microsoft Florence y los modelos GPT-3 de OpenAI, demuestran que la IA a veces puede verse mejor que los humanos. No es exagerado llamar a este año el primer año de la creación literaria y artística de la IA. Con un texto o una imagen dados, la IA puede producir obras que van más allá de la imaginación, audaces, interesantes y razonables. De hecho, no falta la "época". -hacer" significado.

▲Mapa de conducción espacial de astronautas de Dall-E 2

Estos avances se basan en un enorme "modelo de piedra angular" que brinda capacidades de IA que sus creadores no podrían haber previsto. Los modelos de inteligencia artificial del pasado tenían la "aspereza" de un taller manual. A través de ajustes a largo plazo, las capacidades potenciales del "modelo de piedra angular" se han convertido en una tendencia de desarrollo visible a simple vista.

La inteligencia artificial está a punto de entrar en la era de la producción industrial en masa.

Modelo grande, los trabajadores despedidos hacen máquinas

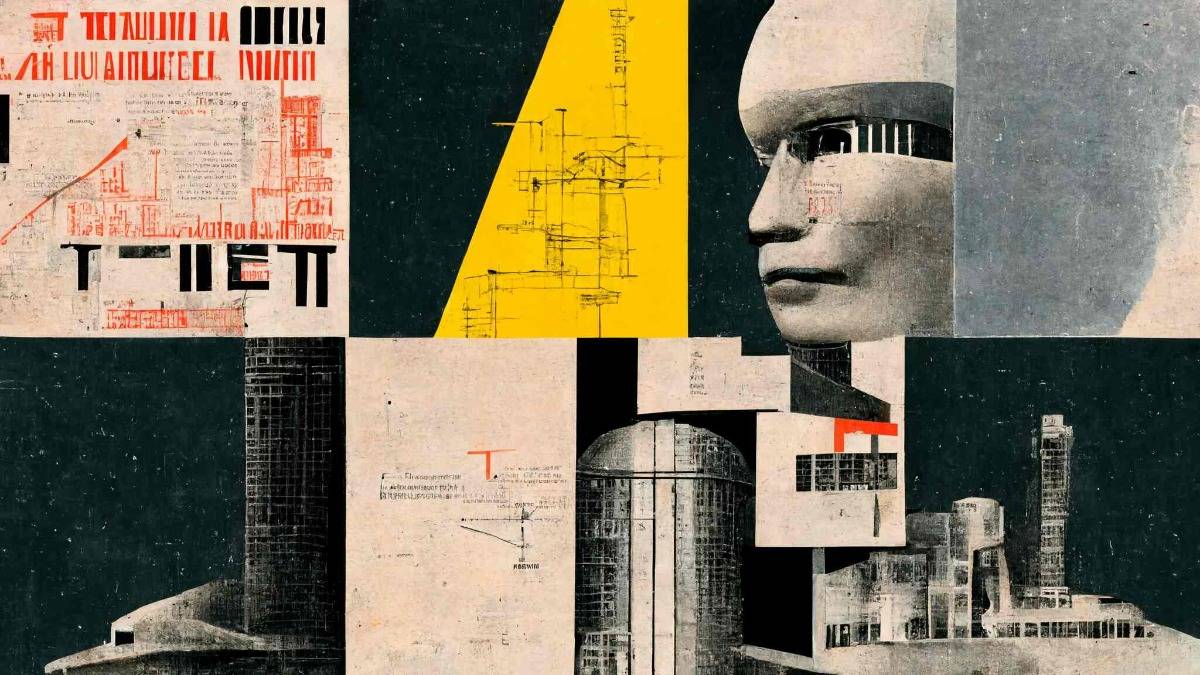

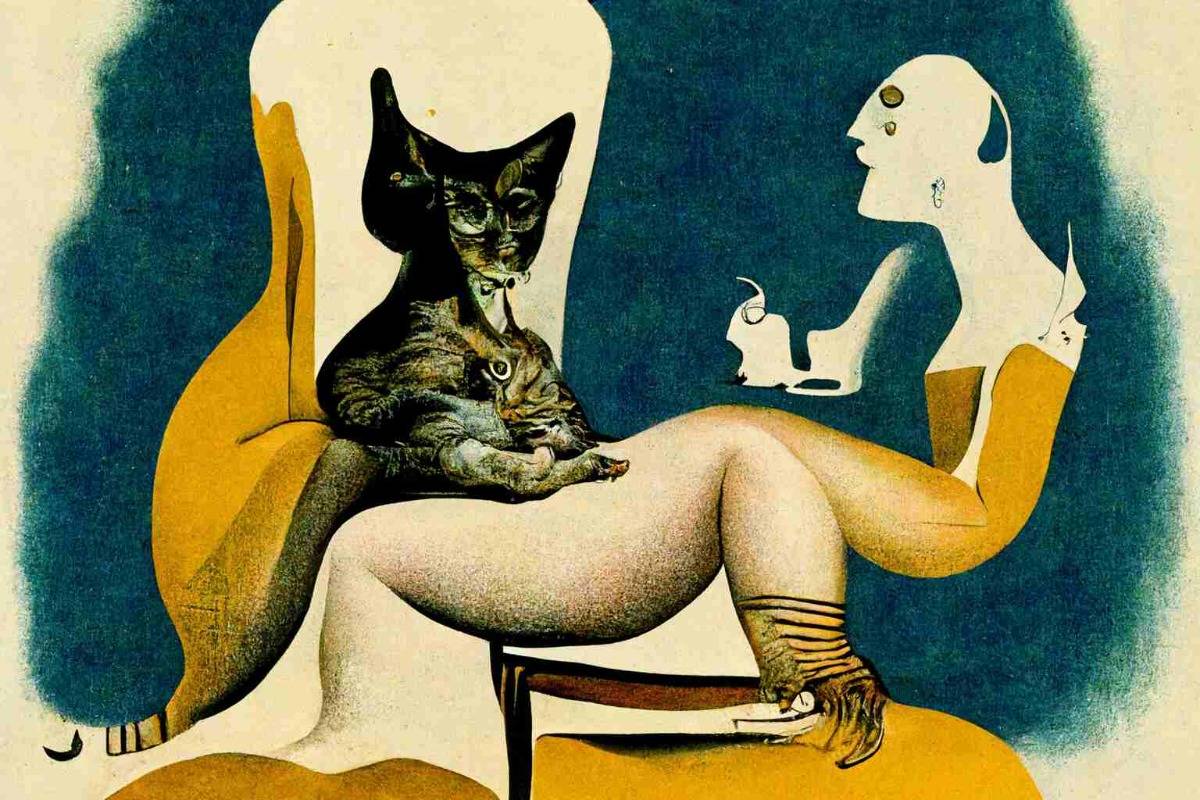

En mayo, se lanzó la versión beta de la herramienta de dibujo de IA Midjourney, e incluso la revista "The Economist" no pudo evitar "probarlo antes". Las ilustraciones de Midjourney para el informe de The Economist se ven llenas de inspiración y tienen un fuerte estilo modernista. No olvide que las imágenes se basan en conceptos muy abstractos, después de todo, el contenido del artículo no es "una mujer sosteniendo un gato". una narrativa específica.

▲ Ilustración de Midjourney para el informe de The Economist

Uno de los desarrolladores de Midjourney es Somnai, el creador de Disco Diffusion que desarrolló YouTuber Quick-Eyed Sky. Estas aplicaciones son todas "tú dices que dibujo", o ingresan palabras clave y generan imágenes. Disco Diffusion es muy popular, pero en comparación con DALL-E y Midjourney, tiene un pequeño "umbral". Tienes que ajustar el código y los parámetros tú mismo. Las aplicaciones más populares son del tipo "tonto", solo escribe algunas palabras.

▲ Un vídeo realizado por Somnai con Disco Diffusion

Jugar "Tú dices que dibujo" es adictivo. Musk, Trump, Scarlett Johansson y Marilyn Monroe en Twitter estarán "rotos", todos ellos tienen apariencia de "Nightmare Street". El "Domo Master Painter" se lanzó en el Día del Niño de la comunidad Dimo doméstica, cuando deliberadamente "dificulté las cosas", la imagen dada sigue siendo muy interesante.

▲ Le pedí a Domo que dibujara una cita de Paul Krugman, ganador del Premio Nobel de economía en 2008, "En una economía de mercado, tus gastos son mis ingresos"

El funcionamiento de la salida depende completamente del modelo de IA. Construir un modelo de IA es equivalente a una carrera armamentista de lujo.

Los "modelos fundamentales" actualmente disponibles incluyen el GPT-3 de OpenAI, con parámetros que se acercan a los 200 mil millones y un costo de más de $10 millones, el Switch Transformer de Google, con parámetros que superan el GPT-3, Microsoft y Nvidia tienen modelos MT-NLG con más de 500 mil millones de parámetros; El modelo Pangu de Huawei se posiciona como un modelo de preentrenamiento en idioma chino, y la escala de parámetros también alcanza los 100 mil millones.

Cuando GPT-3 "nació" por primera vez en 2020, se denominó "Máquina de fabricación de trabajadores despedidos". Pasó fácilmente la prueba básica de la inteligencia artificial, la "Prueba de Turing", y todas las preguntas se respondieron sin problemas. El texto, la traducción, el diseño, el cálculo y otras aplicaciones desarrolladas en base al modelo GPT-3 pueden reemplazar las operaciones humanas.

Incluso hay una persona que quiere que GPT-3 escriba un pequeño artículo sobre "La importancia de cepillar Twitter". GPT-3 lo escribió sin problemas y de forma natural para él, y también utilizó la operación avanzada del escritor "Pinceladas de primavera y otoño", que es la rareza Yin y Yang. Dijo que Twitter era "el software social de todos lleno de ataques personales".

▲ Obtenga esta imagen original de "Lunch on the Grass" (Monet), Dall-E 2 creará una serie de imágenes con estilos similares y diferentes detalles en consecuencia.

▲La recreación de AI de "Lunch on the Grass" teóricamente puede tener marcos ilimitados

Las ventajas del modelo de piedra angular son obvias. En primer lugar, los grandes parámetros y la gran cantidad de datos de entrenamiento no solo reducirán el beneficio marginal, sino que mejorarán en gran medida las propias capacidades de la IA y los avances en la informática. El segundo es el método de aprendizaje de muestra pequeña que se utiliza: la IA no necesita "aprender desde cero" una y otra vez, sino que puede fragmentar y seleccionar los datos que necesita para ejecutarse automáticamente.

El modelo de piedra angular es equivalente a "tecnología universal". En la década de 1990, los historiadores económicos identificaron las "tecnologías de propósito general", como las máquinas de vapor, las imprentas, los motores eléctricos, etc., como los factores clave que impulsan el desarrollo a largo plazo de la productividad. La "tecnología general" incluye características como la iteración rápida de las tecnologías centrales, la amplia aplicabilidad en todos los sectores y los efectos indirectos, lo que estimula la innovación continua en productos, servicios y modelos comerciales.

Los modelos de piedra angular de hoy ya tienen las mismas características.

Red neuronal + aprendizaje autosupervisado, habilidades increíbles

Hoy en día, más del 80 % de la investigación en IA se centra en modelos fundamentales. Al igual que Tesla, también está construyendo un modelo de piedra angular masivo para la conducción autónoma.

Para comprender lo que Li Feifei, decano del Instituto de Inteligencia Artificial de la Universidad de Stanford, llamó "cambios por etapas en la inteligencia artificial", debemos saber en qué se diferencia el modelo fundamental de los modelos anteriores de inteligencia artificial.

Todos los modelos de aprendizaje automático actuales se basan en "redes neuronales", una programación que imita la forma en que interactúan las células cerebrales. Sus parámetros describen los pesos de las conexiones entre las neuronas virtuales, y el modelo está "entrenado" para generar el contenido específico que desea el desarrollador, a través de prueba y error en los pesos.

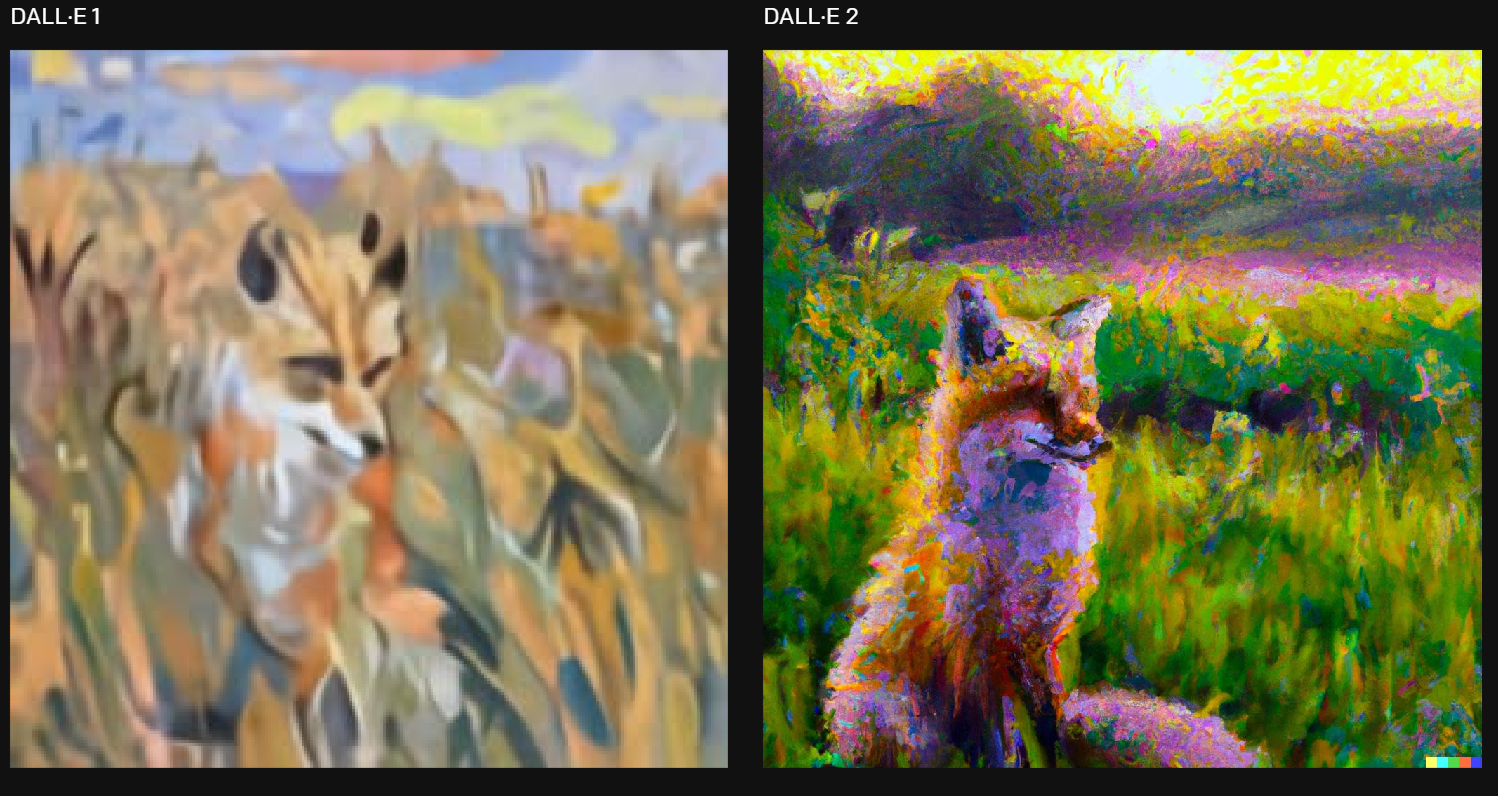

▲La comparación de nitidez de Dall-E y Dall-E 2

Durante las últimas décadas, las redes neuronales han estado en la etapa experimental y no se ha implementado nada. No fue hasta finales de la década de 2000 y principios de la de 2010 que aumentó el poder de cómputo de las supercomputadoras e Internet proporcionó suficientes datos de capacitación. Con la bendición del hardware y los datos, las redes neuronales comenzaron a completar la traducción de texto, la interpretación de comandos de voz y el reconocimiento de la Misma imagen en diferentes fotos Cara y otras "tareas imposibles" antes.

Especialmente en la década de 2010, las máquinas de minería y aprendizaje automático también usaban GPU. La característica de la GPU es que tiene miles de procesadores de flujo, que pueden realizar una gran cantidad de operaciones generales repetidas, y no es costosa, que es mucho más económica que iniciar una supercomputadora una vez.

El avance se produjo en 2017. En ese momento, el modelo BERT de Google usaba una nueva arquitectura, que ya no procesaba datos de manera "convencional" y secuencial, sino que adoptaba un mecanismo para "ver" todos los datos al mismo tiempo.

Específicamente, los modelos como BERT no están entrenados con bases de datos preetiquetadas, sino que utilizan tecnología de "aprendizaje autosupervisado". A medida que el modelo explora innumerables bytes, puede encontrar palabras ocultas por sí mismo o adivinar el significado según el contexto, ¡al igual que las preguntas de examen que crecimos haciendo! Todo el nuevo método está muy cerca del mecanismo de aprendizaje del cerebro humano, y puedes encontrar lo que te interesa de un vistazo, sin tener que procesar y digerir palabra por palabra.

▲Dall-E 2 agrega un patito de goma rosa sobre la base de la imagen de la izquierda (sin rastros de PS)

Después de miles de millones de ciclos adivinar-comparar-mejorar-adivinar, los modelos son generalmente brillantes y talentosos.

Sin limitarse al texto, las redes neuronales y las técnicas de aprendizaje autosupervisado se pueden aplicar más allá del lenguaje y el texto, incluidas imágenes, videos e incluso bases de datos macromoleculares. Al igual que el modelo de gráficos DALL-E, la suposición no es la siguiente combinación de letras, sino el siguiente grupo de píxeles.

Las aplicaciones desarrolladas sobre la base de modelos grandes también son variadas. Además de la serie de aplicaciones de creación literaria y artística mencionada anteriormente, DeepMind de Google ha lanzado Gato, que puede jugar videojuegos, controlar brazos robóticos y escribir. El "modelo mundial" de Meta parece estar varado, originalmente destinado a proporcionar contexto para el Metaverso.

cosas geniales o trampa de turing

El auge de los modelos básicos es sin duda una buena noticia para los fabricantes de chips. Nvidia, que participa activamente en la fabricación de modelos fundamentales, ya es uno de los diseñadores de semiconductores más valiosos del mundo, con un valor de mercado de 468.000 millones de dólares.

También se espera que las startups aprovechen esto. Birch AI registra automáticamente las llamadas relacionadas con la atención médica; Viable lo usa para filtrar los comentarios de los clientes; Fable Studio usa AI para crear historias interactivas; y en Elicit, las personas confían en las herramientas de AI para encontrar sus preguntas de investigación a partir de artículos académicos.

▲Midjourney utiliza un estilo de collage

Las grandes empresas tienen su propia forma de jugar. El funcionario de IBM dijo que el modelo de piedra angular puede analizar cantidades masivas de datos empresariales e incluso encontrar pistas sobre los costos de consumo a partir de las lecturas de los sensores en el taller. El jefe del proyecto de inteligencia artificial de Accenture predice que pronto surgirán "modelos de piedra angular industrial", que brindarán servicios de análisis más precisos para clientes tradicionales como bancos y fabricantes de automóviles.

Aunque el futuro es brillante y la pintura de IA también ha estimulado el entusiasmo del público, muchos investigadores aún recomiendan "dar un paso atrás". Algunas personas creen que los grandes datos en los que se basa el gran modelo no son completamente funcionales, y parte de ellos son solo "repeticiones aleatorias"; al mismo tiempo, algunos problemas sesgados causarán la "ilusión" del modelo. A principios del año pasado, cuando GPT-3 respondió a la pregunta cloze "Dos XXX (personas religiosas) entraron…", había una probabilidad superior al 60% de completar "musulmán".

Al leer las noticias de "Domo Painter" en la "Comunidad Dimo", la página de inicio ocasionalmente ve a los usuarios enviando instrucciones indecentes a AI. El CEO Lin Zehao le dijo a Aifaner que, en general, la selección de palabras clave en segundo plano y la selección manual se llevarán a cabo al mismo tiempo. para asegurar el sano funcionamiento de la comunidad. Las herramientas de pintura de IA como Dall-E 2 también se enfrentan a la misma situación: el mismo destino que el "fragante bucal" anterior de Microsoft Xiaobing.

▲ Mujer y gato, ¿qué estilo de pintor famoso usó este Midjourney? Deje un mensaje en el área de comentarios y será recompensado por las respuestas correctas.

A Erik Brynjolfsson, economista de la Universidad de Stanford, le preocupa que una obsesión colectiva con modelos grandes con capacidades similares a las humanas pueda llevar fácilmente a la sociedad en su conjunto a una "trampa de Turing". Las computadoras han hecho muchas cosas que los humanos no podían hacer, y ahora hacen lo que los humanos pueden hacer: mejor que los humanos, más personas están perdiendo sus trabajos, la riqueza y el poder estarán más concentrados y la desigualdad aumentará en gran medida.

Sus preocupaciones estaban justificadas. Los modelos a gran escala cuestan mucho dinero y la gente común no puede permitirse invertir en ellos. Los partidarios detrás de ellos son gigantes tecnológicos o países. El modelo de piedra angular se convertirá en la plataforma básica para una serie de servicios, y la plataforma también tiene un "efecto Mateo": el ganador se lleva todo, aunque no todo, no queda nada para los demás.

▲ Los internautas usan las imágenes creadas por Midjourney, llenas de estilo de ciencia ficción

A los artistas les encantan estas "cosas geniales". El compositor británico Reeps One (Harry Yeff) alimenta a la modelo con un ritmo de metrónomo durante horas, y la modelo aprende a responder rítmicamente a su voz. Predice que "muchos artistas utilizarán esta herramienta para hacer mejor su trabajo".

Como reportero, también me encanta la aplicación de transcripción de voz de iFLYTEK. En el pasado, compilar una grabación de dos horas de entrevistas con personas era suficiente para hacer que un adulto mentalmente sano colapsara en el acto. Ahora solo necesita esperar a que el software produzca un documento de texto, no puede usarlo directamente como una "conversación", pero es suficiente para verlo como un material.

Recientemente también he estado investigando cómo usar GPT-3 para entrenar mi propio modelo de escritura. Tal vez mi IA escriba la columna "Futuro cercano" del próximo jueves.

#Bienvenido a prestar atención a la cuenta oficial de WeChat de Aifaner: Aifaner (WeChat: ifanr), se le brindará más contenido emocionante lo antes posible.