¿Por qué las cámaras de Android son reacias a usar suela? Filosofía dura

El nivel inferior aplasta a la gente hasta la muerte. La "regla de oro" en boca de este viejo mago parece haber expirado en los teléfonos inteligentes.

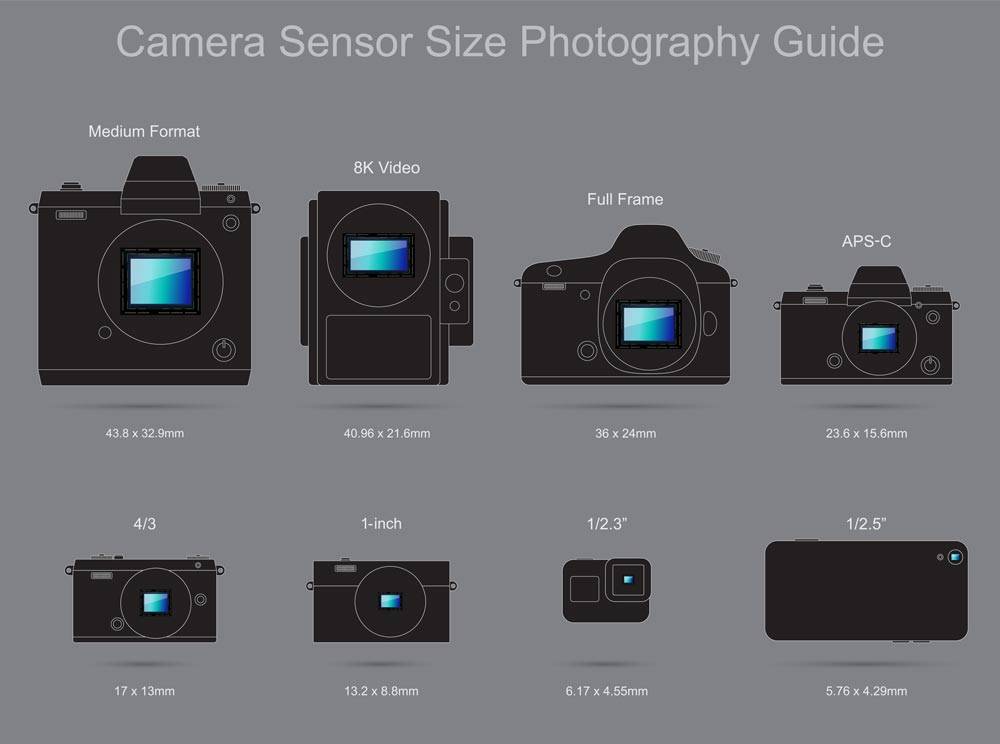

▲ Diferentes "cámaras" están equipadas con diferentes tamaños de sensores. Imagen de: henrys.com

Aunque la "parte inferior" de la cámara del teléfono inteligente se ha vuelto gradualmente más grande, todavía no ha superado el umbral de una pulgada, lo que significa que el teléfono móvil sigue siendo inferior a la tarjeta negra de nivel de entrada en términos de parámetros físicos.

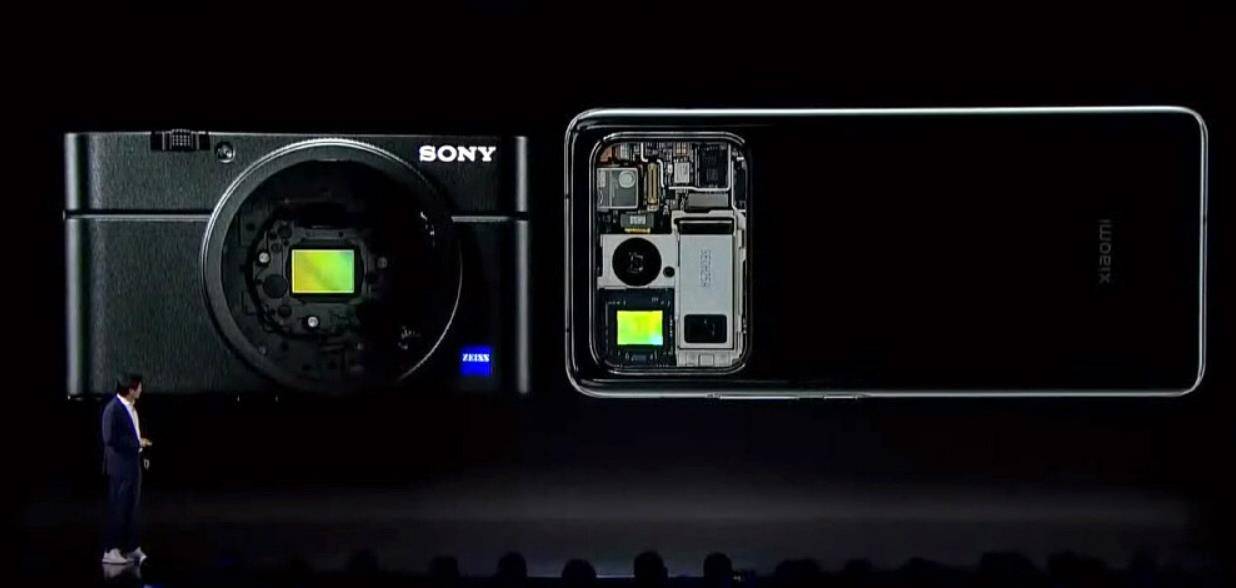

▲ Sony RX100 Black Card vs Xiaomi Mi 11 Ultra.Imagen de: dpreview

Incluso en la conferencia de prensa, el Xiaomi Mi 11 Ultra, que se enfoca en la "imagen", y el tamaño físico de la cámara principal Samsung GN2 de 1/1,12 pulgadas sigue siendo ligeramente diferente de 1 pulgada.

El tamaño del IMX707 personalizado con Sony en el Xiaomi Mi 12 es de solo 1/1,28 pulgadas, el tamaño de la cámara principal GN5 del iQOO 9 Pro en el mismo período es de 1/1,57 pulgadas y el tamaño de la cámara principal Realme GT2 Pro IMX766 es 1/1,56 pulgadas.

▲ Realme GT2 Pro con cámara principal IMX766.

Mirándolo de esta manera, con el tamaño físico CMOS como estándar, en la primera ola del nuevo Snapdragon 8 Gen1, Xiaomi Mi 12 y 12 Pro siguen siendo los productos más favoritos. El tamaño del tamaño del CMOS ya no es el criterio principal para medir el sistema de imágenes del teléfono móvil.

De esta forma, parece que la búsqueda de la cámara principal "super-bottom" se ha convertido en cosa del pasado.

¿Qué significa "aplastar a la gente hasta la muerte"?

En otras palabras, ¿qué ventajas puede aportar la suela?

En pocas palabras, un sensor más grande dará como resultado fotos más limpias, un mejor rendimiento con poca luz y un mejor "bokeh".

Obtener los mismos resultados con sensores más pequeños requiere ISO más bajos, tiempos de obturación más largos y aperturas más grandes.

▲ "Grande" tiene grandes problemas, "pequeño" tiene pequeñas ventajas Imagen de: dpreview

En términos de resultados de imágenes, los sensores de gran tamaño tienen la ventaja de aplastar, pero también pagan un precio.

Para acomodar tamaños de sensor más grandes, las cámaras y lentes también han crecido exponencialmente en tamaño. Para distribuir la luz uniformemente sobre el sensor, el complejo diseño óptico duplicará el peso de la lente. Y con eso viene el costo, que es el dinero.

▲ Una comparación intuitiva del tamaño del sistema de fotograma completo y el sistema M43. Imagen de: wildshots

El sensor de tamaño pequeño es todo lo contrario, y el volumen, el peso y el costo también se reducen.

Estrictamente hablando, el tamaño del sensor es proporcional a la calidad de la imagen, así como al volumen, peso y precio.

Siempre habrá un "punto dulce" entre ellos, en los sistemas de cámaras, el fotograma completo es, y en los teléfonos inteligentes, la pulgada que cada fabricante se esfuerza por lograr puede ser.

Hasta el advenimiento de la "fotografía computacional".

El avance de la "fotografía computacional"

Ya sea una cámara o un teléfono inteligente, el principio de imagen no es más que que la lente controle la luz para ingresar al CMOS, el CMOS realiza la conversión fotoeléctrica y luego el sensor de imagen la restaura a una imagen.

A juzgar por el proceso anterior, no hay posibilidad de que el teléfono móvil derrote a la cámara, a menos que la "espada vaya de lado".

En comparación con los fuertes atributos de herramientas de las cámaras, los teléfonos inteligentes en realidad están más inclinados a los "resultados". El público en general usa los teléfonos móviles para grabar de manera más informal y rara vez va a la posedición, enfocándose en "intercambio de una sola vez".

▲ iPhone 13 Pro vs Pixel 6 Pro. Imagen de: cnet

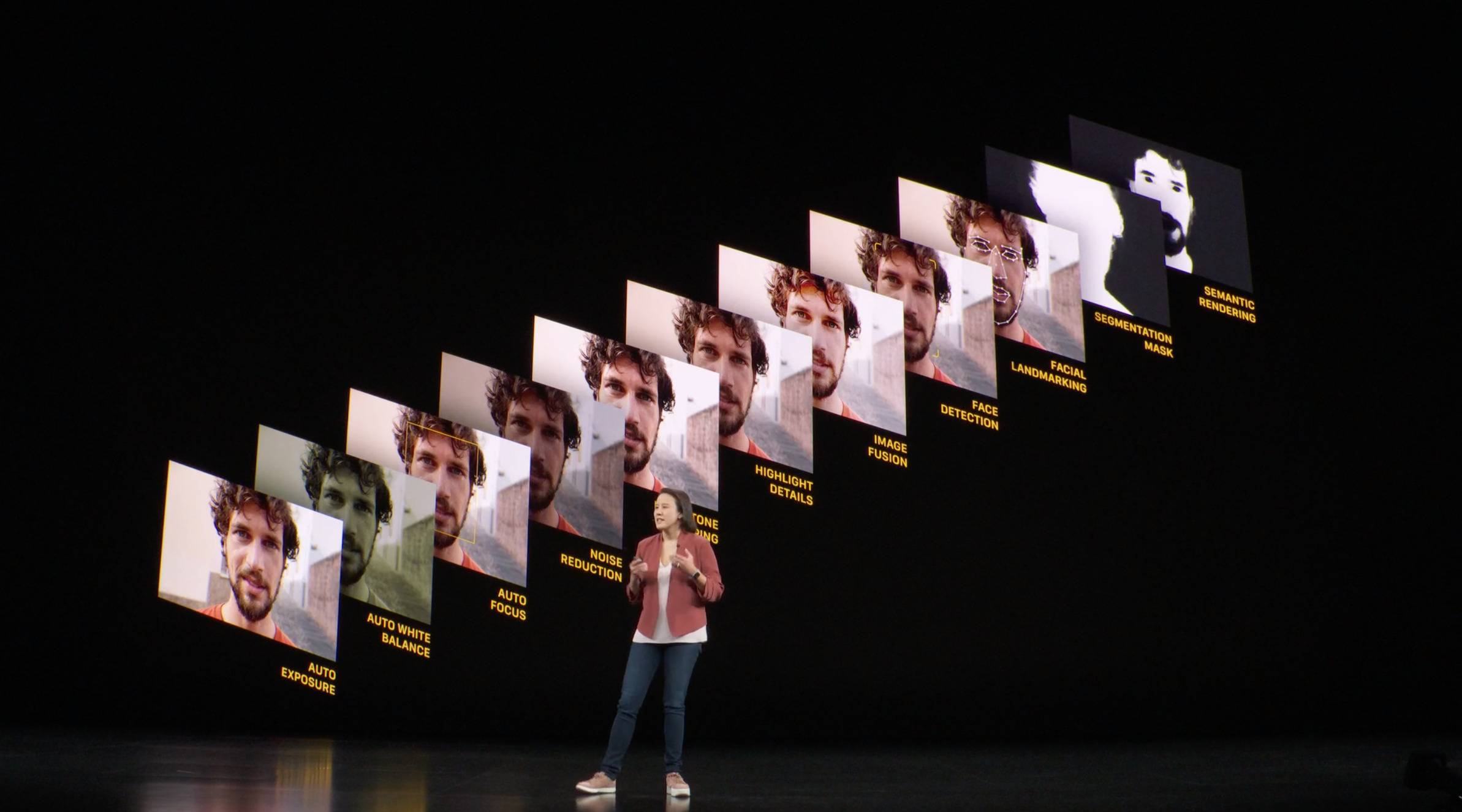

Con el aumento de la potencia informática de IA en los SoC de teléfonos móviles, la fotografía de teléfonos móviles se ha desarrollado gradualmente desde HDR simple y síntesis de múltiples fotogramas de escenas nocturnas hasta HDR en tiempo real, simulación de gran apertura y modos complejos de "escena nocturna".

A través de la mejora sustancial de la potencia informática de la IA y la combinación refinada de diferentes algoritmos de imagen, el proceso de creación de imágenes de teléfonos inteligentes ya no es tradicional, sino que ha agregado una gran cantidad de componentes de "computación".

En el pasado, cuando se filmaba con una cámara, a menudo era necesario planificar y elegir los proyectos de filmación por adelantado, lo que también dio origen a algunas experiencias clásicas como la Decimosexta regla de la luz del sol.

Los teléfonos inteligentes nacieron para ser "talla única", y cualquier escena, sujeto e iluminación deben manejarse con facilidad. El proceso de grabación tradicional de adquisición, procesamiento y restauración no es adecuado para el sistema de imágenes del teléfono móvil.Después del cálculo y el ajuste de la IA, la salida está más en línea con los resultados deseados por los usuarios de teléfonos móviles.

A medida que la fotografía computacional se generaliza gradualmente, las especificaciones del hardware de la cámara ya no son la única medida del poder de la imagen. El poder de la imagen se ha convertido gradualmente en una manifestación de fuerza integral, que incluye no solo un mejor hardware, sino también mejores algoritmos de IA.

El rendimiento más potente de ISP e IA en el SoC también afecta la potencia de imagen del teléfono móvil junto con el CMOS y la lente.

El auge de los chips de desarrollo propio

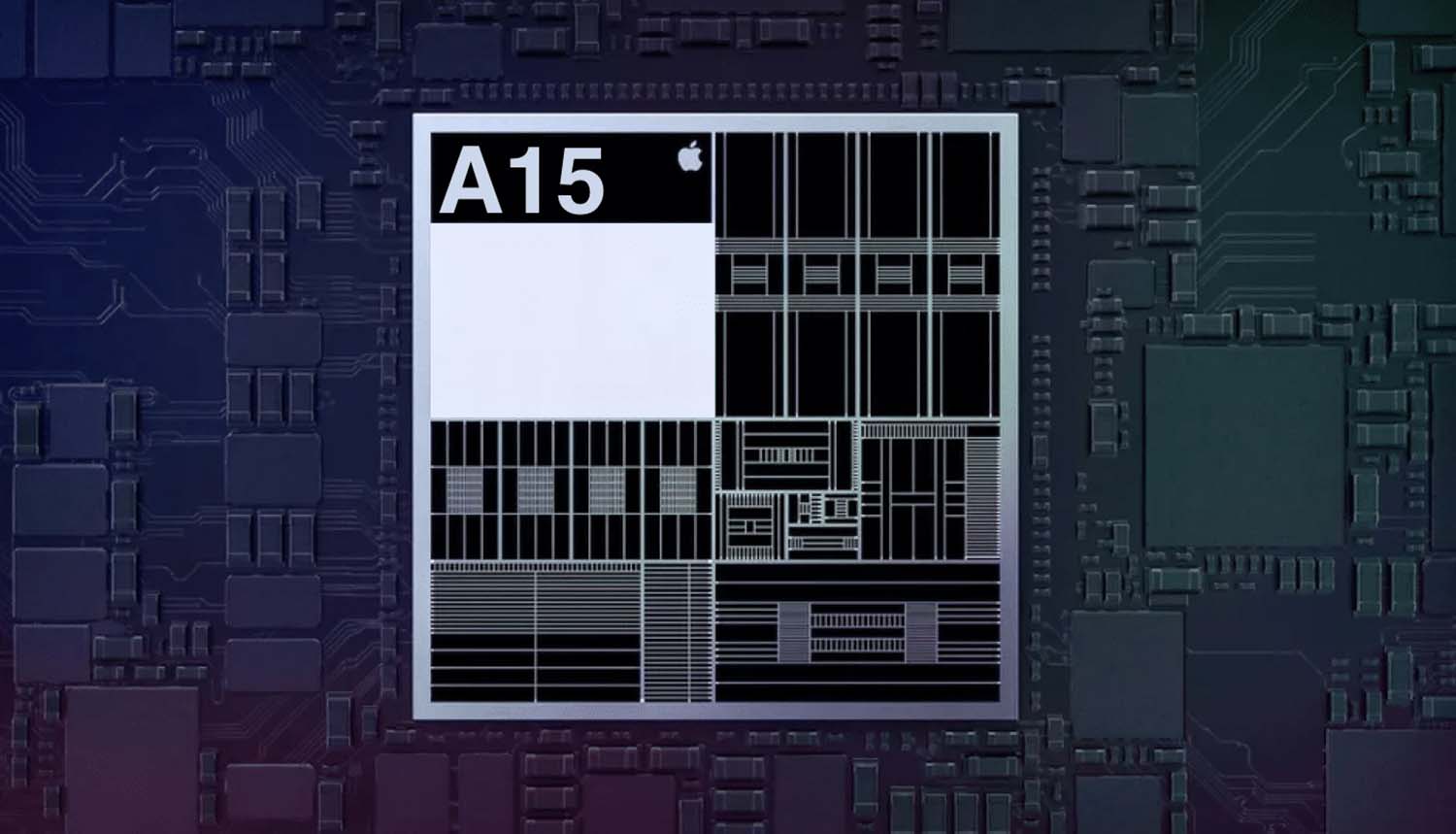

Ya sean los chips de la serie A de Apple o los chips de la serie 8 de Qualcomm, en las iteraciones de actualización recientes, en comparación con la pequeña mejora en el rendimiento de la CPU y la GPU, ya sea la cantidad de núcleos o la cantidad de transistores, el motor de computación neuronal tiene varias veces o incluso una docena de veces mejora.

▲ El A15 puede realizar 15,8 billones de cálculos de IA por segundo Imagen de: Apple

Estas mejoras se utilizan en todos los aspectos del producto, y la fotografía computacional basada en aprendizaje automático profundo es una de ellas.

Aunque la potencia de cómputo de la IA en el SoC se ha mejorado mucho, sigue siendo una solución general y hay poca diferencia en el rendimiento de la presentación de imágenes personalizadas y los efectos de fotografía computacional entre diferentes plataformas.

Para los fabricantes de teléfonos móviles que buscan constantemente la diferenciación, esto está lejos de ser suficiente, por lo que los chips "extra" en los teléfonos móviles para diferenciar la imagen son muy comunes.

▲ vivo X70 Pro+ con ISP integrado de desarrollo propio vivo V1.

Por ejemplo, el Surging C1 en el Xiaomi MIX FOLD, el V1 en la serie vivo X70 y el chip Mariana X que pronto aparecerá en la serie Find X5 tendrán sus propias características en la imagen.

Recuerdo que cuando probé vivo X70 Pro+, quedé profundamente impresionado por los tonos únicos y el sólido rendimiento con poca luz. Y cuando la imagen se "calcula" cuadro por cuadro, el chip adicional es más eficiente energéticamente de lo que es y también ahorra energía.

▲ La NPU de desarrollo propio de OPPO, Mariana X, con grandes esperanzas. Imagen de: OPPO

El chip Mariana X de OPPO también resuelve el problema de una mayor potencia informática y una alta relación de eficiencia energética para las imágenes.

Con la mejora de la potencia informática del chip y la mejora de los algoritmos, en términos del efecto final de las imágenes de teléfonos móviles, la fotografía computacional, el aprendizaje profundo de la máquina y los algoritmos de IA traerán cambios más evidentes para los usuarios comunes.

▲ Sony Xperia Pro-I con un sensor de imagen integrado de una pulgada. Imagen de: Petapixel

Desde 1/2,8 pulgadas hasta 1/1,12 pulgadas, o incluso 1 pulgada, en muchas escenas tomadas con teléfonos móviles, es difícil detectar cambios sin una comparación cuidadosa.

Si cambia el marco de referencia, es difícil para la gente común distinguir la diferencia entre las fotos obtenidas por la cámara de marco completo y la cámara de marco APS-C en la misma escena con la misma lente.

El llamado "lo más importante en fotografía es la cabeza hacia atrás" probablemente signifique lo mismo.

Un chip ISP independiente y de desarrollo propio (o NPU de imagen), o fotografía computacional, resuelve el problema de "la cabeza en la parte posterior".

En este momento en que la IA es popular, las especificaciones de hardware tradicionales están más cerca de las "materias primas" de un plato, mientras que la fotografía computacional se parece más a un chef que puede cocinar cinco platos principales y cocinar según la temporada y el estado de ánimo. La importancia no puede ser exagerada.

Quiere dominar la tecnología central

El año pasado, se presentó oficialmente el nuevo MacBook Pro equipado con chips de desarrollo propio M1 Pro y M1 Max, y Google Pixel 6 Pro también estaba equipado con un chip Tensor "de desarrollo propio", mientras que vivo V1, Surging P1, Mariana X también deje que vivo, Xiaomi, OPPO se involucre por primera vez en la fabricación de núcleos.

▲ Tensor de Google.

El movimiento de "fabricación de núcleos" se ha convertido en el tema principal de la industria de la electrónica de consumo en 2021.

Los chips de la serie M de Apple son conocidos por sus altos índices de eficiencia energética y se adaptan bien al hardware, formando una barrera ecológica con otros productos. El Tensor del Pixel 6 Pro también está relacionado con Android 12 en cierta medida, pero aún no ha constituido una barrera.

▲ El Tensor personalizado de Google, combinado con Android 12, hace que la serie Pixel 6 sea "el teléfono Pixel más inteligente".

En cuanto a los ISP y NPU personalizados de los fabricantes nacionales, aunque el chip es pequeño, es suficiente para aportar ciertas ventajas a la imagen, y ni siquiera descarta la formación final de las barreras de las marcas.

Desde la aparición de la cámara en el teléfono móvil, su desarrollo es exactamente el mismo que el de los fabricantes de imágenes tradicionales. La base más grande, el píxel más alto y la apertura más grande siempre han sido el tema principal. Por esta razón, la cámara se levanta y ocupa un espacio considerable en la máquina.

▲ Leitz Phone 1 con sensor de imagen de una pulgada.Imagen de: leica

Sin embargo, a medida que se acerca al límite superior, el efecto marginal se vuelve más y más evidente y la mejora del efecto de formación de imágenes deja de ser significativa.

Hasta la aparición de la "fotografía computacional" y los chips ISP de desarrollo propio, la dirección de desarrollo de las imágenes de teléfonos móviles se ha invertido por completo, y la fotografía computacional guiada por algoritmos y aprendizaje automático se está convirtiendo en el principal campo de batalla.

▲ Xiaomi 11 Ultra, Leitz Phone 1, iPhone 12 Pro Max. Imagen de: XDA

El sensor de suela con mayor volumen y costo ya no es la primera opción de los fabricantes de teléfonos móviles, sino que se prefiere el "tuning" del sensor, es decir, la optimización de algoritmos basada en hardware maduro, y el uso de chips de imagen independientes (ISP, NPU ) Crear barreras de imagen únicas.

Es previsible que cuando no se rompan las leyes de la física y la óptica, cuando se lance el nuevo teléfono en los próximos años, el foco de la imagen estará en torno a la computación de IA, el aprendizaje automático, los tonos únicos, el enfoque de velocidad extrema y otros”. cálculos". El tamaño y el modelo serán cada vez más reducidos.

#Bienvenido a prestar atención a la cuenta oficial de WeChat de Aifaner: Aifaner (WeChat: ifanr), se le brindará más contenido emocionante lo antes posible.