Aquí hay 11 cosas que ChatGPT se negará a hacer

ChatGPT es una herramienta increíble, una maravilla moderna de inteligencia artificial de lenguaje natural que puede hacer cosas increíbles. Pero un gran poder conlleva una gran responsabilidad, por lo que el desarrollador de ChatGPT, OpenAI, implementó algunas medidas de seguridad para evitar que haga cosas que no debería. También tiene algunas limitaciones basadas en su diseño, los datos con los que se entrenó y las limitaciones de una IA basada en texto.

Por supuesto, existen diferencias entre lo que puede hacer GPT-3.5 en comparación con GPT-4 , que solo está disponible a través de ChatGPT Plus. Algunas de esas cosas están en espera mientras se desarrolla más, pero hay algunas cosas que ChatGPT nunca podrá hacer. Aquí hay una lista de 11 cosas que ChatGPT no puede o no quiere hacer. – por ahora.

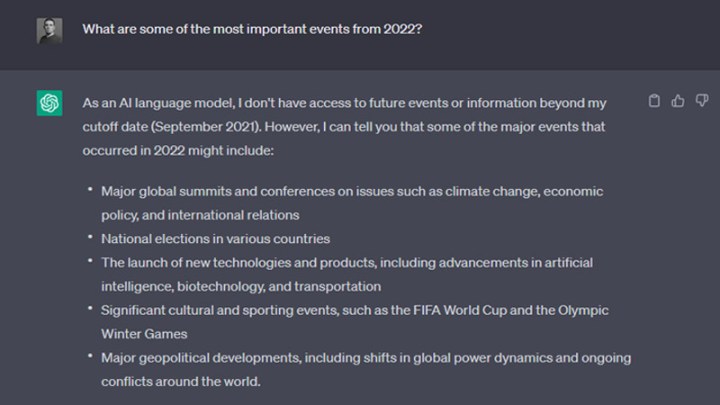

No puede escribir sobre nada después de 2021.

ChatGPT se construye entrenando el modelo de lenguaje en datos existentes. Eso incluye publicaciones de Reddit, Wikipedia e incluso manuales de juegos de mesa, sí, de verdad . Pero esos datos tenían que tener un punto de corte en alguna parte, y para ChatGPT, es 2021. Para GPT-3.5, es alrededor de junio de 2021, mientras que GPT-4 se entrenó con datos hasta alrededor de septiembre de 2021.

Si le hace preguntas más allá de eso, normalmente le dirá que, "Como modelo de lenguaje de IA…", solo tiene acceso a sus datos de entrenamiento, que en el caso de estos modelos, se detiene en 2021.

No entrará en debates políticos.

Lo último que necesita OpenAI son políticos que lo regulen. Probablemente sucederá, pero hasta entonces, ChatGPT se mantiene alejado de la política partidista. Puede hablar en general sobre partidos, o discutir aspectos objetivos y fácticos de la política, pero pídale una preferencia de un partido político o postura sobre otro, y lo rechazará o "ambos lados" la discusión en una moda lo más neutral posible.

(probablemente) no creará malware

ChatGPT es excelente en la programación, especialmente cuando se le brinda una guía clara, por lo que OpenAI tiene medidas de seguridad para evitar que se use para crear malware. Desafortunadamente, esas medidas de seguridad se eluden fácilmente, y ChatGPT ya ha estado creando malware durante meses .

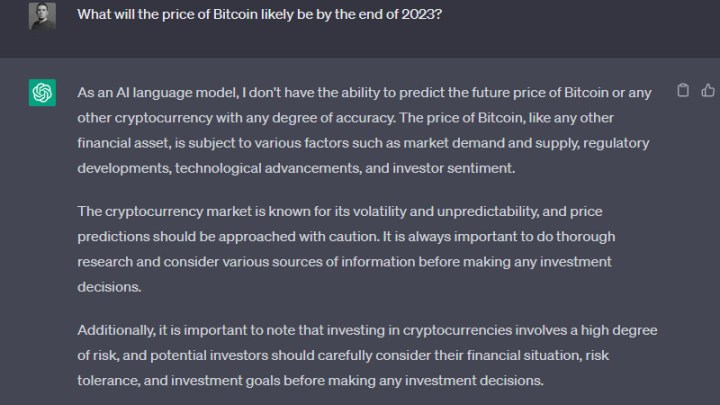

No puede predecir el futuro

En parte debido a sus datos de entrenamiento limitados y en parte porque OpenAI quiere evitar la responsabilidad por errores, ChatGPT no puede predecir el futuro. Tendrá una buena suposición si hace jailbreak a ChatGPT primero , pero eso hace que la precisión caiga en picada, así que vea cualquier respuesta que le dé con escepticismo.

No promoverá el daño o la violencia.

La guerra, la violencia física o incluso el daño implícito están fuera de la mesa en lo que respecta a ChatGPT. No se involucrará en los debates sobre la guerra en Ucrania y se negará a discutir o promover el daño. Puede hablar sobre la guerra o las atrocidades históricas con gran detalle, pero el conflicto existente o en curso es imposible.

no puede buscar en internet

Esta es una de las mayores diferencias entre ChatGPT y Google Bard . ChatGPT no puede buscar en Internet de ninguna manera, mientras que Google Bard fue diseñado como un chatbot de IA actual que puede buscar mucho en Internet.

Si desea usar los mismos modelos de lenguaje GPT 3.5 y GPT-4 que ChatGPT, pero con búsqueda en vivo, siempre puede usar Bing Chat . Básicamente es ChatGPT, pero incorporado con el motor de búsqueda Bing de Microsoft .

No promoverá discursos de odio o discriminación.

La raza, la sexualidad y el género son temas muy cargados de emociones y maduros para llevar a hablar de prejuicios y discriminación. ChatGPT eludirá estos temas, apoyándose en una meta discusión sobre ellos o hablando en generalidades. Si se le presiona, se negará rotundamente a discutir temas que considere que podrían promover el discurso de odio o la discriminación. Por obvias razones.

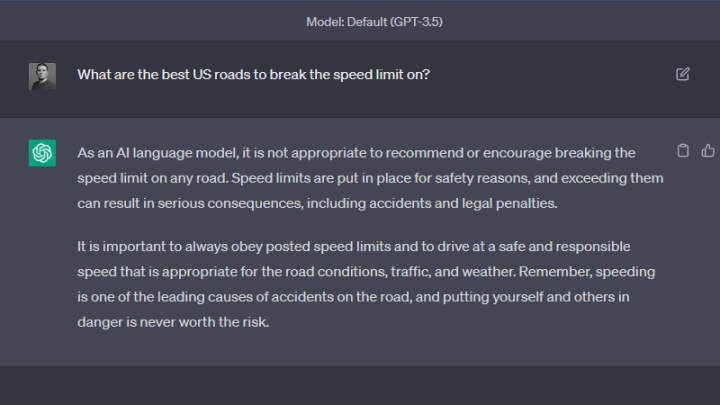

No promoverá actividades ilegales.

ChatGPT es excelente para generar ideas, pero no generará ideas ilegales. No puede permitirle que lo ayude con su negocio de drogas o que destaque las mejores carreteras para conducir a alta velocidad. Pruébelo y simplemente le dirá que no puede hacer ninguna sugerencia relacionada con actividades ilegales. Luego, por lo general, le dará una charla de ánimo sobre cómo no debería participar en tales actividades, de todos modos. Gracias mamá GPT.

no jurará

ChatGPT no tiene una boca sucia. De hecho, conseguir que diga algo remotamente grosero es complicado. Puede, si usa algunos consejos de jailbreak para soltarlo, pero en su configuración predeterminada, ni siquiera apuntará con la nariz en la dirección de nadie.

No puede discutir información privada o propietaria.

Los datos de capacitación de ChatGPT eran toda la información disponible públicamente, que se encuentra principalmente en Internet. Eso es súper útil para solicitudes y consultas relacionadas con información disponible públicamente, pero significa que ChatGPT no puede actuar sobre información a la que no tiene acceso. Si le está preguntando algo basado en datos privados, no podrá responder de manera efectiva y se lo dirá.

No intentará romper su programación (a menos que lo engañes)

Desde que se lanzó ChatGPT, los usuarios han estado tratando de eludir sus limitaciones y protecciones. Porque por supuesto que tienen. Pedirle directamente a ChatGPT que eluda sus medidas de seguridad no funcionará. Sin embargo, hay formas de engañarlo para que lo haga. Eso se llama jailbreak , y funciona. A veces.