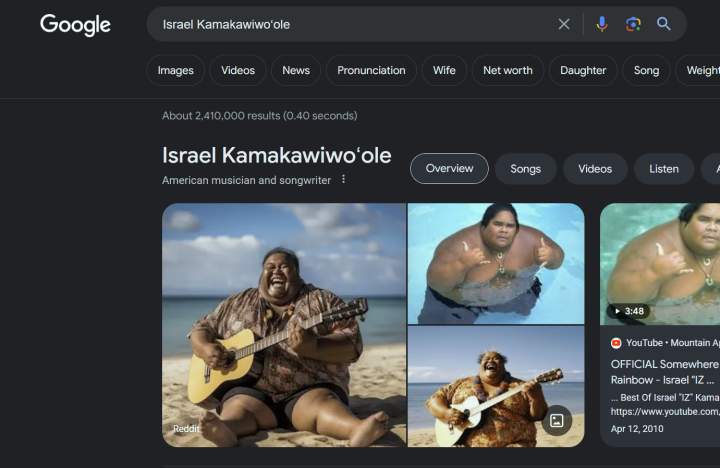

Aparecen imágenes falsas de IA en la búsqueda de Google, y es un problema

En este momento, si escribes “Israel Kamakawiwoʻole” en la búsqueda de Google, no verás una de las famosas portadas de los álbumes del cantante, ni una imagen de él interpretando una de sus canciones con su icónico ukelele. Lo primero que ves es una imagen de un hombre sentado en una playa con una sonrisa en el rostro, pero no una foto del hombre tomada con una cámara. Esta es una foto falsa generada por IA. De hecho, cuando haces clic en la imagen, te lleva al subreddit Midjourney , donde se publicaron inicialmente la serie de imágenes.

Vi esto publicado por primera vez por Ethan Mollick en X (anteriormente conocido como Twitter), un profesor de Wharton que estudia IA.

Al mirar la foto de cerca, no es difícil ver todos los rastros de IA que quedan en ella. El efecto de profundidad de campo falsa se aplica de manera desigual, la textura de su camisa está confusa y, por supuesto, le falta un dedo en la mano izquierda. Pero nada de eso es sorprendente. Por muy buenas que se hayan vuelto las imágenes generadas por IA durante el año pasado, todavía son bastante fáciles de detectar cuando se mira de cerca.

Sin embargo, el verdadero problema es que estas imágenes aparecen como el primer resultado de una figura famosa y conocida sin marcas de agua ni indicios de que haya sido generada por IA. Google nunca ha garantizado la autenticidad de los resultados de su búsqueda de imágenes, pero hay algo que resulta muy preocupante en esto.

Ahora, hay algunas posibles explicaciones de por qué sucedió esto en este caso particular. El cantante hawaiano, comúnmente conocido como Iz, falleció en 1997 y Google siempre quiere ofrecer la información más reciente a los usuarios. Pero dado que no se han publicado muchos artículos o debates nuevos sobre Iz desde entonces, no es difícil ver por qué el algoritmo captó esto. Y si bien para Iz no parece particularmente trascendental, no es difícil imaginar algunos ejemplos que serían mucho más problemáticos.

Incluso si no seguimos viendo que esto suceda a escala en los resultados de búsqueda, es un excelente ejemplo de por qué Google necesita tener reglas al respecto. Como mínimo, parece que las imágenes generadas por IA deberían marcarse claramente de alguna manera antes de que las cosas se salgan de control. Al menos, al menos dénos una forma de filtrar automáticamente las imágenes de IA. Sin embargo, dado el propio interés de Google en el contenido generado por IA , hay razones para pensar que podría querer encontrar formas de introducir contenido creado por IA en sus resultados, y no marcarlo claramente.