Nvidia presenta su nueva herramienta NeMo Guardrails para desarrolladores de IA, y promete hacer que los chatbots de IA como ChatGPT sean un poco menos locos. El software de código abierto ya está disponible para los desarrolladores y se centra en tres áreas para hacer que los chatbots de IA sean más útiles y menos inquietantes.

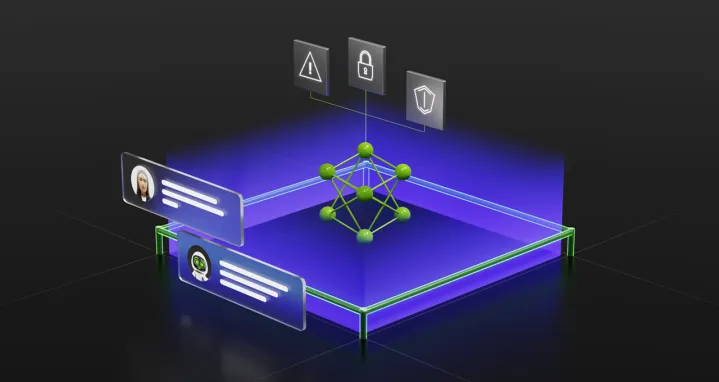

La herramienta se encuentra entre el usuario y el modelo de lenguaje grande (LLM) con el que interactúa. Es una seguridad para los chatbots, interceptar las respuestas antes de que lleguen al modelo de lenguaje para evitar que el modelo responda o para darle instrucciones específicas sobre cómo responder.

Nvidia dice que NeMo Guardrails se centra en los límites temáticos, de seguridad y protección. El enfoque temático parece ser el más útil, ya que obliga al LLM a permanecer en un rango particular de respuestas. Nvidia hizo una demostración de Guardrails mostrando un chatbot entrenado en la base de datos de recursos humanos de la empresa. Cuando se le hizo una pregunta sobre las finanzas de Nvidia, dio una respuesta enlatada que estaba programada con NeMo Guardrails.

Esto es importante debido a las muchas llamadas alucinaciones que hemos visto en los chatbots de IA. Bing Chat de Microsoft , por ejemplo, nos proporcionó varias respuestas extrañas y objetivamente incorrectas en nuestra primera demostración. Cuando se enfrenta a una pregunta que el LLM no entiende, a menudo inventa una respuesta en un intento de satisfacer la consulta. NeMo Guardrails tiene como objetivo poner fin a esas respuestas inventadas.

Los principios de seguridad y protección se centran en filtrar las respuestas no deseadas del LLM y evitar que los usuarios jueguen con él. Como ya hemos visto, puedes hacer jailbreak a ChatGPT y otros chatbots de IA. NeMo Guardrails tomará esas consultas y las bloqueará para que nunca lleguen al LLM.

Aunque NeMo Guardrails se diseñó para mantener a los chatbots enfocados y precisos, no es una solución general. Nvidia dice que funciona mejor como segunda línea de defensa y que las empresas que desarrollan e implementan chatbots aún deben entrenar el modelo en un conjunto de medidas de seguridad.

Los desarrolladores también necesitan personalizar la herramienta para que se ajuste a sus aplicaciones. Esto permite que NeoMo Guardrails se asiente sobre el middleware que los modelos de IA ya usan, como LangChain, que ya proporciona un marco sobre cómo se supone que los chatbots de IA interactúan con los usuarios.

Además de ser de código abierto, Nvidia también ofrece NeMo Guardrails como parte de su servicio AI Foundations . Este paquete proporciona varios modelos y marcos previamente entrenados para empresas que no tienen el tiempo o los recursos para entrenar y mantener sus propios modelos.